О НЕКОТОРЫХ ОСОБЕННОСТЯХ ИНТЕГРИРОВАННЫХ ПЛОСКОСТНЫХ МНОГОСПЕКТРАЛЬНЫХ УСТРОЙСТВ ПОЛУЧЕНИЯ ИЗОБРАЖЕНИЙ И ИХ ИСПОЛЬЗОВАНИИ В СИСТЕМАХ ОБЪЕДИНЕНИЯ ИЗОБРАЖЕНИЙ

М.С. Смагин

ЗАО «МНИТИ»

Email: smagin@mniti.ru

Содержание

Аннотация

Современные достижения в области электроники и физики материалов позволяют в настоящее время создавать новые виды многоспектральных устройств получения изображений плоскостного и объемного типа. Следует отметить, что отличительной особенностью сенсоров плоскостного типа является расположение элементов, чувствительных в различных спектральных диапазонах, на единой плоскости в виде единого массива с мозаичным расположением элементов. Использование плоскостных устройств дает ряд важных преимуществ, однако требует модифицирования алгоритмов объединения изображений путем внесения дополнительных операций так называемой «демозаики». Кроме того, встает вопрос о наиболее эффективном, с точки зрения синтеза информативных объединенных изображений, пространственном расположении чувствительных элементов различных спектральных диапазонов в плоскостном матричном устройстве получения изображений.

В представляемой статье изложены результаты исследования наиболее широко применяемых алгоритмов объединения изображений (PCA, DWT; пирамида лапласианов) с точки зрения их устойчивости при работе с мозаичными исходными изображениями для различных вариантов пространственной компоновки чувствительных элементов в матричных устройствах получения изображений. На примере нескольких пар исходных изображений, полученных в различных спектральных диапазонах, исследована устойчивость данных алгоритмов к работе с матричными исходными изображениями различного вида, а также определено наиболее эффективное положение операции демозаики в последовательности операций исследованных алгоритмов.

Ключевые слова: многоспектральные устройства, объединение изображений, PCA

1. Введение

В представляемой вашему вниманию статье под многоспектральными системами наблюдения местности, понимаются системы получения изображений, оснащенные несколькими датчиками, чувствительными в различных спектральных диапазонах, осуществляющие одновременное представление получаемых спектральных изображений оператору с целью повышения его ситуационной осведомленности. Указанные изображения могут демонстрироваться оператору раздельно на нескольких мониторах, однако в настоящее время все шире применяется операция объединения изображений. Под объединением изображений чаще всего понимается процесс комбинирования информации, содержащейся в нескольких изображениях, с целью получения одного результирующего изображения, более пригодного для восприятия человеком-оператором или для дальнейшей машинной обработки, чем любое из исходных [1,2].

Пример объединения изображений видимого и тепловизионного (7-14 мкм) диапазонов представлен на рисунках 1 и 2.

|

Тепловизионное изображение |

Изображение видимого диапазона |

Рис. 1. Пример исходных изображений для объединения

Рис. 2 Пример результирующего объединенного изображения

Анализ характеристик современных многоспектральных систем наблюдения местности позволяет выявить ряд интересных тенденций. Среди них наиболее интересны следующие:

- использование новых видов устройств получения изображений, построенных на основе новейших чувствительных материалов [3-5];

- объединение чувствительных элементов, работающих в различных спектральных диапазонах электромагнитных волн, в интегрированные многоспектральные устройства получения изображений с единой матрицей чувствительных элементов [6,7].

Указанные тенденции взаимосвязаны, поскольку новые чувствительные материалы с улучшенными эксплуатационными характеристиками (например, чувствительностью в широкой полосе частот) или показателями технологичности (например, производимые с помощью полиграфических методов вместо фотолитографии) позволяют создавать новые типы устройств получения изображений.

В зависимости от конструктивных особенностей, такие устройства могут быть разделены на два типа: объемные и плоскостные. Объемные устройства представляют собой многослойные трехмерные структуры, состоящие из нескольких слоев чувствительных элементов, работающих в различных частотных диапазонах электромагнитного спектра. Плоскостные устройства, напротив, содержат один слой чувствительных элементов, размещенных в одной плоскости в виде мозаики.

Существуют также устройства, сочетающие признаки обоих классов, например, устройство, описанное в [8], однако по сравнению с предыдущими классами, они упоминаются в незначительном числе публикаций.

Объемные устройства не нашли широкого применения, ввиду сложности в производстве. Кроме того, значительная часть инженерных решений, необходимых для эффективной работы такого рода устройств, являются интеллектуальной собственностью фирмы Foveon Inc.

Плоскостные же устройства, судя по количеству современных публикаций, вызывают гораздо больший интерес.

Использование интегрированных устройств получения изображений в многоспектральных устройствах наблюдения местности не только позволяет достичь более высоких пользовательских характеристик последних, но и требует решения ряда принципиально новых задач. Если традиционные многоспектральные системы наблюдения местности чаще всего используют для каждого из рабочих диапазонов отдельное устройство получения изображений, выполненное в отдельном корпусе с собственной оптической системой [9, 10], то использование интегрированных устройств получения изображений позволяет снизить массогабаритные характеристики таких систем. Оно также позволяет избежать проблем, связанных с рассогласованием оптических осей, а также уменьшить вычислительную сложность алгоритмов объединения изображений за счет отказа от операции совмещения исходных изображений.

Что же касается новых задач, то они, в свою очередь, связаны с особенностями структурной организации интегрированных устройств получения изображения. Определяющим фактором для плоскостных устройств является их мозаичная структура.

Если рассматривать вопрос мозаичной структуры с точки зрения объединения изображений, необходимо сказать, что ее использование автоматически требует внесения в алгоритмы объединения дополнительных операций по компенсации искажений, возникающих при объединении мозаичных изображений. Такие операции в повседневном научно-техническом обиходе получили название «демозаики», в соответствии с английским термином demosaicing. Соответственно, первую из возникающих задач можно сформулировать следующим образом, - как внедрить операцию демозаики в алгоритм объединения, чтобы его негативное влияние на объединенное изображение было минимальным.

Данной проблеме посвящено большое количество работ [11-13], однако большинство из них рассматривают вопрос синтеза цветных изображений с использованием метода спектрального кодирования, когда исходные изображения, рассматриваются как субспектральные компоненты объединенного, соответствующие определенным участкам видимого спектра, т. е. отдельным цветовым составляющим объединенного цветного изображения. Метод спектрального кодирования, сам по себе, является одним, но далеко не единственным, из множества алгоритмов объединения изображений. Причем, в общем случае, далеко не самым лучшим, поскольку он не позволяет удалять с объединенных изображений шумы и нежелательные элементы исходных изображений, например, такие как туман и дым.

Другой особенностью указанных работ является общая тенденция к увеличению субспектральных компонент, т. е. исходных изображений. Как правило, используется три исходных изображения, соответствующие трем базовым цветам видимого спектра, однако в некоторых работ количество субспектральных компонент увеличивается до восьми и более. Так типичный для задач объединения случай двух монохромных изображений, полученных в разных спектральных диапазонах электромагнитных волн (видимый диапазон и ближний участок инфракрасного (ИК) диапазона, коротковолновой и длинноволновой участки ИК-диапазона и т. д.), часто оказывается вне рассмотрения.

Кроме того, самих способов мозаичной структурной организации чувствительных элементов в фотоприемной матрице существует несколько. Они различаются особенностями расположения чувствительных элементов, работающих в различных спектральных диапазонах, друг относительно друга.

В связи с этим, второй важной задачей является вопрос определения способа конструктивного исполнения фотоприемной матрицы, который бы обеспечивал наиболее высокую информативность результирующего объединенного изображения.

2. Постановка задачи

Исходя из вышесказанного, можно сказать, что представленное в данной статье исследование было направлено на экспериментальное решение следующих задач:

1. Установление позиции операции демозаики в последовательности операций алгоритмов объединения изображений, при которой потери информативности объединенного изображения будут минимальны.

2. Определение способа взаимного расположения элементов фотоприемной матрицы, чувствительных в различных спектрах, при котором достигался бы максимум информативности результирующего изображения.

В предлагаемой статье описаны результаты экспериментов, проводившихся с целью решения указанных задач.

3. Исходные изображения, алгоритмы и программное обеспечение, использованные при проведении экспериментов

В описанных ниже экспериментах было использовано несколько наборов из пар изображений, полученных в различных спектральных диапазонах, либо же с помощью систем получения изображений с разными характеристиками. Часть изображений взято из библиотек, размещенных в открытом доступе в сети «Интернет» [14], часть являются собственностью ЗАО «МНИТИ». Образцы изображений, сгруппированные в наборы, представлены в таблице 1.

Таблица 1

|

|

|

|

Тепловизионное изображение |

Видимое изображение |

|

|

|

|

Средневолновое ИК-изображение |

Видимое изображение |

|

|

|

|

ИК-изображение (нет данных по поддиапазону) |

Низкоуровневое видимое изображение |

|

|

|

|

Видимое изображение с дальним фокусом |

Видимое изображение с ближним фокусом |

Для экспериментов использовались три хорошо известных алгоритма объединения изображений: алгоритм анализа главных компонент (PCA-алгоритм [15]), алгоритм пирамиды лапласианов [16], алгоритм на основе дискретного вейвлет-преобразования (DWT-алгоритм) [17]. В качестве программной реализации указанных алгоритмов, использовался пакет программ для среды MATLAB, разработанный Оливером Рокингером и размещенный в открытом доступе в сети «Интернет» [18].

Рассмотрим данные алгоритмы чуть подробнее. Теоретическая основа метода главных компонент заключается в том, что изображения, представленные в цифровой форме в виде матриц значений яркостей пикселей размерностью N×M, рассматриваются как точки в NM-мерном пространстве, для которых значения яркостей пикселей служат координатами. Соответственно, получение объединенного изображения сводится к вычислению координат точки, лежащей посередине между точками, соответствующими исходным изображениям. После чего необходимо вычислить весовые коэффициенты, на которые надо умножить радиус-вектора отложенные от начала координат к исходным точкам, так чтобы при их сложении получился радиус-вектор, проведенный к вычисленной ранее результирующей точке. Указанные весовые коэффициенты используются для получения объединенного изображения путем попарного взвешенного сложения значений яркостей соответствующих пикселей исходных изображений. Практически, данная задача решается путем вычисления собственных векторов и собственных значений матрицы ковариации двух исходных изображений. Весовые коэффициенты объединения определяются как компоненты нормализованного собственного вектора матрицы ковариации, соответствующего наибольшему из её вычисленных собственных значений.

В основе алгоритма пирамиды лапласианов и DWT-алгоритма лежит несколько иной принцип. Суть обоих заключается в разделении исходного изображения на составляющие с низкой и высокой пространственной частотой. Причем данная операция может выполняться многократно, т.е. полученная на очередном шаге высокочастотная составляющая исходного изображения разделяется повторно и т. д. Число итераций, в большинстве случаев, варьируется от двух до пяти. Предполагается, что низкочастотные составляющие вероятнее соответствуют фону или (в системах наблюдения местности) подстилающей поверхности или фону, а высокочастотные, соответственно, ‒ наблюдаемым объектам. Полученные наборы составляющих объединяются между собой как отдельные изображения (высокочастотные, чаще всего, суммируются, а низкочастотные – усредняются), после чего процесс повторяется в обратном порядке. Осуществляется «сборка» объединенного изображения из частотных составляющих путем их суммирования.

Разница же между алгоритмом пирамиды лапласианов и DWT-алгоритмом заключается в методе частотного разделения исходных и изображений и, как следствие, в количестве изображений, получаемых на каждой итерации алгоритма.

4. Замысел эксперимента

Основным замыслом эксперимента являлось моделирование процесса объединения изображений с последовательным изменением параметров моделирования, соответствующих положению операции демозаики в последовательности операций алгоритма объединения, а также параметров, соответствующих пространственному расположению чувствительных элементов в матричном устройстве получения изображений. Целью являлось, соответственно, выявить наилучшее сочетание указанных параметров, позволяющее получать наиболее информативные объединенные изображения.

Более детальное описание конкретного набора параметров, взятых как соответствующие операции демозаики и пространственному расположению чувствительных элементов, представлено ниже.

4.1. Расположение операции демозаики в последовательности операций алгоритма объединения изображений;

Объединению изображений, как отдельному научному направлению в рамках обработки изображений уже более 30 лет. За это время было разработано весьма значительное количество различных алгоритмов объединения. И соответственно, было разработано несколько систем их классификации. Согласно системе классификации, изложенной в [19], которой мы и будем следовать в дальнейшем, алгоритмы объединения можно разделить на алгоритмы уровня пикселей, уровня областей и уровня решений.

Основным объектом рассмотрения в настоящем исследовании были алгоритмы уровня пикселей, как наиболее часто используемые и реализуемые в составе программно-аппаратных систем. Алгоритмы уровня областей и уровня решений, соответственно, будут рассмотрены в дальнейшем.

Рассматривая общую структуру алгоритмов уровня пикселей, в ней можно выделить две основных стадии. Каждая из них, в зависимости от сложности алгоритма объединения, может быть единичной операцией, последовательной цепочкой операций или самостоятельным алгоритмом. Классификационным критерием при таком разбиении, выступает совместность или независимость обработки исходных изображений.

На этапе независимой обработки, который, как правило, предшествует этапу совместной обработки, осуществляется анализ и/или обработка исходных изображений. Он может содержать такие виды операций, как улучшение, многомасштабные или вейвлет-преобразования и т. д., а результатом его работы является обработанное исходное изображение, либо группа промежуточных изображений, полученных в ходе преобразования исходного.

Этап совместной обработки использует выходную информацию этапа независимой обработки в качестве входной, а основной его задачей является синтез результирующего объединенного изображения. Т. е. Собственно объединение осуществляется именно на данном этапе.

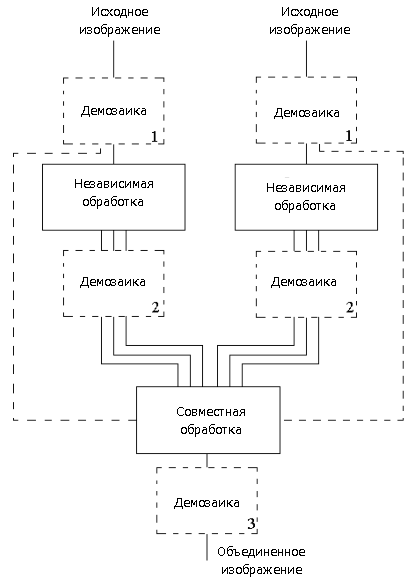

Соответственно, операция демозаики может быть введена в алгоритм перед обоими этапами (демозаика исходных изображений), между ними (демозаика результатов обработки), либо после них (демозаика объединенного изображения).

Общая схема алгоритма объединения изображений с возможными местами ввода операции демозаики представлена на рисунке 1р.

Прямоугольники, соответствующие возможным положениям операции демозаики, нарисованы прерывистой линией, чтобы обозначить возможное положение операции демозаики, которая может быть помещена на позицию 1, 2 или 3. Линии, показывающие передачу исходных изображений для дальнейшей обработки, также нарисованы также прерывистой линией, чтобы показать, что они могут использоваться, а могут и не использоваться в операции объединения в зависимости от особенностей конкретного алгоритма. Возможность того, что в результате выполнения этапа независимой обработки может быть получена не одна, а несколько объектов данных также отражена на рисунке 3 множеством линий между этапами независимой и совместной обработки.

Ниже, в разделе результатов, представлены результаты моделирования для всех трех возможных позиций операции демозаики.

Рис. 3. Общая схема процесса объединения изображений с указанием возможных позиций операции демозаики

4.2. Пространственное расположение чувствительных элементов в матричном устройстве получения изображений

Особенности пространственного расположения чувствительных элементов также выступали объектами исследования. Цель указанных исследований заключалась в том, чтобы определить форму пространственного расположения, дающую минимальную потерю информации после выполнения операции демозаики.

Безусловно, даже при наличии всего двух типов чувствительных элементов, можно предложить массу различных вариантов их расположения в пределах двумерной матрицы, однако для дальнейшего исследования было выбрано следующие три формы, отличающиеся наибольшей простотой и удобством к практической реализации в аппаратуре:

- расположение по строкам, когда любые две соседние строки содержат элементы, чувствительные в различных спектральных диапазонах;

- расположение по столбцам, когда, соответственно, любые два соседних столбца, содержат различные элементы;

- диагональное расположение, аналогичным образом для двух диагональных линий, такое расположение ещё часто называют «шахматной доской».

Моделирование всех указанных форм осуществлялось путем создания редуцированных изображений, состоявших, соответственно, только из четных либо нечетных строк, столбцов, или диагональных линий исходных изображений. Эксперименты ставились как для случаев четных, так и для случаев нечетных строк, столбцов и диагоналей, но существенной разницы между ними двумя выявить не удалось, так что при дальнейшем рассмотрении фактор четности-нечетности выборки пикселей не учитывался.

5. Описание эксперимента

На первом этапе эксперимента осуществлялся синтез объединенных изображений для каждой из пар исходных изображений для каждого из исследуемых алгоритмов. Данные изображения использовались в дальнейшем для оценки потерь информации для каждого из вариантов компоновки матричного сенсора и позиции операции демозаики в алгоритме.

На втором этапе эксперимента осуществлялся синтез объединенных изображений для различных форм пространственного расположения чувствительных элементов в матричном датчике изображений (путем использования различных редуцированных изображений) и различных положений операции демозаики в последовательности операций алгоритма объединения. Указанные операции проводились для каждого из исследуемых алгоритмов объединения изображений. Получаемые объединенные изображения сравнивались с образцовыми, полученными на первом этапе эксперимента, с целью оценки потери информации.

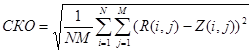

Оценка потери информации проводилась путем подсчета среднеквадратичной ошибки (СКО), между образцовыми объединенными изображениями, и объединенными изображениями, полученными на втором этапе эксперимента на основе обработки редуцированных изображений с последующей демозаикой. Подсчет СКО осуществлялся по следующей формуле [2]:

Где N и M – число пикселей в изображениях по горизонтали и вертикали (количество строк и столбцов), а R(i,j) и Z(i,j) – значения яркостей пикселей сравниваемых изображений с координатами i и j соответственно.

На основании результатов, полученных для каждого из наборов, вычислялось среднее арифметическое значение по всем наборам исходных изображений. Полученные средние значения представлены ниже, как финальные результаты.

6. Результаты и выводы

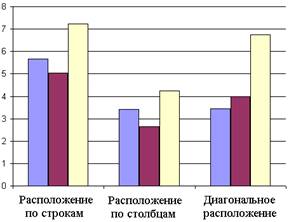

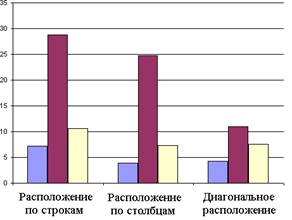

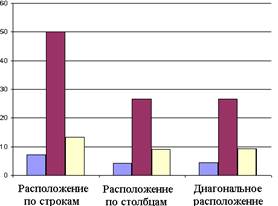

Полученные результаты, сгруппированные в зависимости от использованного алгоритма объединения, положения операции демозаики и пространственного расположения чувствительных элементов, представлены в приведенных ниже таблицах. В таблице 2 представлены результаты, полученные для случая применения операции демозаики на исходных изображениях. Таблица 3, соответственно, отражает результаты, полученные при промежуточном расположении операции демозаики. В таблице 4 же представлены результаты, полученные при демозаике объединенных изображений.

Значения в таблицах представляют собой показатели СКО, вычисленные относительно образцовых объединенных изображений, полученных на нередуцированных исходных изображениях без использования демозаики, и объединенных изображений, полученных из редуцированных исходных изображений с демозаикой. Полученные величины вычислялись путем усреднения исходных значений, полученных для разных исходных изображений и разных (четных и нечетных) комбинаций выборки строк, столбцов или диагоналей.

Интересно также отметить, что для всех представленных в таблицах средних величин характерна малая дисперсия исходных значений, по которым проводилось усреднение. То есть, можно утверждать, что выявленная закономерность не зависит от особенностей исходных изображений, например, спектрального диапазона, в котором они получены.

Для каждого из случаев показаны как абсолютные значения СКО, так и приведенные относительно половинного значения динамического диапазона (составляющего 256 градаций яркости), поскольку они ярче демонстрируют отклонение полученных изображений от образцового.

Представленные значения позволяют оценить потерю информации, возникающую на объединенных изображениях за счет редукции и демозаики. Уровень потерь информации возрастает с ростом как абсолютных значений СКО, так и относительных, приведенных в процентах.

Таблица 2

|

|

PCA-алгоритм |

Алгоритм пирамиды лапласианов |

DWT-алгоритм |

|||

|

Расположение по строкам |

5,67 |

4 % |

7,16 |

5 % |

7,25 |

6 % |

|

Расположение по столбцам |

3,41 |

3 % |

3,92 |

3 % |

4,15 |

3 % |

|

Диагональное расположение |

3,45 |

3 % |

4,29 |

3 % |

4,44 |

3 % |

Таблица 3

|

|

PCA-алгоритм |

Алгоритм пирамиды лапласианов |

DWT-алгоритм |

|||

|

Расположение по строкам |

5,05 |

4 % |

28,82 |

22 % |

50,00 |

39 % |

|

Расположение по столбцам |

2,66 |

2 % |

24,78 |

20 % |

26,53 |

21 % |

|

Диагональное расположение |

3,98 |

3 % |

11,01 |

9 % |

26,66 |

21 % |

Таблица 4

|

|

PCA-алгоритм |

Алгоритм пирамиды лапласианов |

DWT-алгоритм |

|||

|

Расположение по строкам |

7,24 |

6 % |

10,63 |

8 % |

13,24 |

10 % |

|

Расположение по столбцам |

4,24 |

3 % |

7,36 |

6 % |

9,15 |

7 % |

|

Диагональное расположение |

6,75 |

5 % |

7,57 |

6 % |

9,24 |

7 % |

Об устойчивости исследованных алгоритмов к различным вариантам пространственной ориентации чувствительных элементов в многоэлементном матричном датчике изображений удобно судить, если представить полученные значения в виде диаграмм, представленных на рисунке 4.

|

а |

б |

|

в |

|

Рисунок 4

Представленные диаграммы позволяют визуально сравнить представленные в таблицах 2-4 значения СКО при различных вариантах расположения чувствительных элементов для PCA-алгоритма (рисунок 4а), алгоритма пирамиды лапласианов (рисунок 4б) и DWT-алгоритма (рисунок 4в). Как можно видеть, практически во всех случаях наблюдается более или менее ярко выраженный минимум значений СКО в области, соответствующей расположению чувствительных элементов по столбцам.

Анализ представленных результатов позволил сделать ряд выводов:

1. Демозаика исходных изображений перед объединением является наиболее эффективным путем внедрения операции демозаики в последовательность операций алгоритма объединения изображений;

2. Демозаика объединенных изображений также возможна, поскольку позволяет получать результирующие изображения с близким, хотя все же несколько большим уровнем искажений по сравнению с объединенными изображениями, получаемыми при демозаике исходных изображений. Уровень вычислительных затрат, при этом, снижается за счет того, что операции демозаики подвергается уже не два исходных изображения, а лишь одно результирующее;

3. Расположение чувствительных элементов в матричном датчике изображений по столбцам позволяет достичь меньших потерь информации по сравнению с диагональным и, в особенности, строчным расположением;

4. Исследованные алгоритмы объединения показали разную степень устойчивости при работе с мозаичными исходными изображениями. Если PCA-алгоритм показал высокую устойчивость во всех случаях, то алгоритм пирамиды лапласианов и, в особенности, DWT-алгоритм продемонстрировали значительную потерю информативности объединенных изображений, субъективно воспринимаемую как практически полное (например, для случая демозаики промежуточных изображений DWT-алгоритма, показанного в таблице 2) разрушение объединенного изображения.

Список литературы

1. Piella G. A general framework for multiresolution image fusion: from pixels to regions. Information fusion. 2003. Vol. 4. No. 4. Pp. 259-280.

2. Blum R. Image Fusion with Some Emphasis on CWD. US Army Research Office Electrical Engineering and Computer Science Department Lehigh University. Tech. Rep. DAAD19-00-1-0431.

3. Diedenhofen S.L. et al. Integrated colloidal quantum dot photodetectors with color-tunable plasmonic nanofocusing lenses. Light: Science & Applications. 2015. Vol. 4. No. 1. P. e234.

4. Gong X. et al. High-detectivity polymer photodetectors with spectral response from 300 nm to 1450 nm. Science. 2009. Vol. 325. No. 5948. Pp. 1665-1667.

5. Park H. Vertical Silicon Nanowires for Image Sensor Applications. 2014.

6. Frigerio J. et al. Electronic Imaging & Signal Processing Multispectral imaging sensors integrated on silicon. URL: http://spie.org/newsroom/4861-multispectral-imaging-sensors-integrated-on-silicon (Access date: 29.07.2016)

7. Kiku D. et al.. Simultaneous capturing of RGB and additional band images using hybrid color filter array. IS&T/SPIE Electronic Imaging. International Society for Optics and Photonics, 2014. Pp. 90230V-90230V-9.

8. Lim S. J. et al. Organic-on-silicon complementary metal-oxide-semiconductor colour image sensors. Scientific reports. 2015. Vol. 5.

9. Podobna Y. et al. Modular multi-channel imaging system for littoral observation and target detection. SPIE Defense, Security, and Sensing. International Society for Optics and Photonics, 2012. Pp. 837202-837202-10.

10. Dual Band SWIR Security Camera System [Электронный ресурс]. URL: http://www.photonicsonline.com/doc/dual-band-swir-security-camera-system-0001 (Access date: 29.07.2016)

11. Lapray P. J. et al. Multispectral filter arrays: Recent advances and practical implementation. Sensors. 2014. Vol. 14. No. 11. Pp. 21626-21659.

12. Eichenholz J. M., Dougherty J. Ultracompact fully integrated megapixel multispectral imager. SPIE OPTO: Integrated Optoelectronic Devices. – International Society for Optics and Photonics, 2009. Pp. 721814-721814-10.

13. Shrestha R., Hardeberg J. Y., Khan R. Spatial arrangement of color filter array for multispectral image acquisition. IS&T/SPIE Electronic Imaging. International Society for Optics and Photonics, 2011. Pp. 787503-787503-9.

14. Image and image sequence fusion [Электронный ресурс]. URL: http://www.metapix.de/fusion. (Access date: 29.07.2016)

15. Sharma R. K., Pavel M., Leen T. K. Multistream video fusion using local principal components analysis. SPIE's International Symposium on Optical Science, Engineering, and Instrumentation. International Society for Optics and Photonics, 1998. Pp. 717-725.

16. Akerman III A. Pyramidal techniques for multisensor fusion. Applications in Optical Science and Engineering. International Society for Optics and Photonics, 1992. Pp. 124-131.

17. Pajares G., De La Cruz J. M. A wavelet-based image fusion tutorial. Pattern recognition. 2004. Vol. 37. No. 9. Pp. 1855-1872.

18. Image fusion toolbox for matlab 5.x [Электронный ресурс]. URL: http://www.metapix.de/toolbox.htm (Access date: 29.07.2016)

19. Hall D. L., Llinas J. Handbook for multisensor data fusion (Electrical engineering and applied signal processing). 2001.

ON SOME ASPECTS OF INTEGRATED MULTISPECTRAL SINGLE-LAYER IMAGING ARRAYS AND THEIR APPLICATION FOR IMAGE FUSION

M. Smagin

Joint-Stock Company MNITI

Email: smagin@mniti.ru

Abstract

Modern advancements in electronics and physics have created the opportunity to develop new types of multispectral image sensors with single or multiple sensitive layers. The distinctive feature of single-layer imaging arrays is the arrangement of its elements (sensible in different spectral bands) in a single plane that form a united array organized as a mosaic. Practical application of such imaging arrays for image fusion allows us to gain some important advantages, but it also requires the modification of fusion algorithms by adding the demosaic operation into the sequence of operations. It also creates the need to determine the proper spatial arrangement of sensible elements in the single-layer array, which allows the achievement of the best results, i.e. the most informative fused images.

The following article describes the result of a case study focused on the task to determine the robustness of several well-known image fusion algorithms (PCA, DWT and Laplacian Pyramid) to mosaic images and different types of spatial arrangements of sensors in multispectral image acquisition arrays. Several couples of source images (obtained in different spectral bands) were used to test the performance of the abovementioned algorithms on mosaicked images in order to find the most effective position of the demosaic operation in the sequence of operations in the tested algorithms.

Keywords: multispectral arrays, image fusion, PCA

References

1. Piella G. A general framework for multiresolution image fusion: from pixels to regions. Information fusion. 2003. Vol. 4. No. 4. Pp. 259-280.

2. Blum R. Image Fusion with Some Emphasis on CWD. US Army Research Office Electrical Engineering and Computer Science Department Lehigh University. Tech. Rep. DAAD19-00-1-0431.

3. Diedenhofen S.L. et al. Integrated colloidal quantum dot photodetectors with color-tunable plasmonic nanofocusing lenses. Light: Science & Applications. 2015. Vol. 4. No. 1. P. e234.

4. Gong X. et al. High-detectivity polymer photodetectors with spectral response from 300 nm to 1450 nm. Science. 2009. Vol. 325. No. 5948. Pp. 1665-1667.

5. Park H. Vertical Silicon Nanowires for Image Sensor Applications. 2014.

6. Frigerio J. et al. Electronic Imaging & Signal Processing Multispectral imaging sensors integrated on silicon. URL: http://spie.org/newsroom/4861-multispectral-imaging-sensors-integrated-on-silicon (Access date: 29.07.2016)

7. Kiku D. et al. Simultaneous capturing of RGB and additional band images using hybrid color filter array. IS&T/SPIE Electronic Imaging. International Society for Optics and Photonics, 2014. Pp. 90230V-90230V-9.

8. Lim S. J. et al. Organic-on-silicon complementary metal-oxide-semiconductor colour image sensors. Scientific reports. 2015. Vol. 5.

9. Podobna Y. et al. Modular multi-channel imaging system for littoral observation and target detection. SPIE Defense, Security, and Sensing. International Society for Optics and Photonics, 2012. Pp. 837202-837202-10.

10. Dual Band SWIR Security Camera System. URL: http://www.photonicsonline.com/doc/dual-band-swir-security-camera-system-0001 (Access date: 29.07.2016)

11. Lapray P. J. et al. Multispectral filter arrays: Recent advances and practical implementation. Sensors. 2014. Vol. 14. No. 11. Pp. 21626-21659.

12. Eichenholz J. M., Dougherty J. Ultracompact fully integrated megapixel multispectral imager. SPIE OPTO: Integrated Optoelectronic Devices. – International Society for Optics and Photonics, 2009. Pp. 721814-721814-10.

13. Shrestha R., Hardeberg J. Y., Khan R. Spatial arrangement of color filter array for multispectral image acquisition. IS&T/SPIE Electronic Imaging. International Society for Optics and Photonics, 2011. Pp. 787503-787503-9.

14. Image and image sequence fusion. URL: http://www.metapix.de/fusion. (Access date: 29.07.2016)

15. Sharma R. K., Pavel M., Leen T. K. Multistream video fusion using local principal components analysis. SPIE's International Symposium on Optical Science, Engineering, and Instrumentation. International Society for Optics and Photonics, 1998. Pp. 717-725.

16. Akerman III A. Pyramidal techniques for multisensor fusion. Applications in Optical Science and Engineering. International Society for Optics and Photonics, 1992. Pp. 124-131.

17. Pajares G., De La Cruz J. M. A wavelet-based image fusion tutorial. Pattern recognition. 2004. Vol. 37. No. 9. Pp. 1855-1872.

18. Image fusion toolbox for matlab 5.x. URL: http://www.metapix.de/toolbox.htm (Access date: 29.07.2016)

19. Hall D. L., Llinas J. Handbook for multisensor data fusion (Electrical engineering and applied signal processing). 2001.