ИСПОЛЬЗОВАНИЕ ГЛУБОКИХ СВЁРТОЧНЫХ НЕЙРОННЫХ СЕТЕЙ ДЛЯ АВТОМАТИЧЕСКОГО ВЫДЕЛЕНИЯ ПРЕПЯТСТВИЙ НА ВЗЛЕТНО-ПОСАДОЧНОЙ ПОЛОСЕ ПО ДАННЫМ ВИДИМОГО И ИНФРАКРАСНОГО ДИАПАЗОНА

В.В. Князь1,2, В.В. Федоренко1, В.А. Мизгинов1, В.А. Князь1,2, В. Пургатхофер3

1ГОСНИИАС, 125319, Москва,Россия;

2Московский физико-технический институт (государственный университет), Москва, Россия;

3TU-Wien – Венский Университет Технологий, Вена, Австрия.

vl.kniaz@gosniias.ru, vfedorenko@gosniias.ru, vl.mizginov@gosniias.ru, knyaz@gosniias.ru, wp@cg.tuwien.ac.at

Содержание

4. Построение обучающей выборки

5. Обучение свёрточной нейронной сети и тестирование алгоритма

Аннотация

Контроль чистоты поверхности взлётно-посадочной полосы является важным фактором обеспечения безопасности воздушного движения. Современный уровень развития датчиков и методов обработки поступающих от них данных обеспечивает необходимые предпосылки для решения задачи обнаружения и активной визуализации препятствий по данным тепловизионных камер в автоматическом режиме, что позволяет повысить эффективность уборки взлётно-посадочной полосы. Перспективным средством анализа мультиспектральных видеопоследовательностей являются глубокие свёрточные нейронные сети.

Данной статья посвящена разработке модифицированной архитектуры глубокой свёрточной сети SqueezeNet для решения задачи автоматического выделения препятствий по видеопоследовательностям видимого и дальнего инфракрасного диапазонов.

Ключевые слова: глубокие свёрточные нейронные сети, тепловизионные изображения, обнаружение препятствий, взлётно-посадочная полоса, семантическая сегментация, визуализация.

1. Введение

Перспективным способом уборки взлётно-посадочной полосы (ВПП) являются колёсные роботы, оснащённые тепловизионными системами технического зрения. Управление роботом осуществляется удалённо из диспетчерского пункта. Оператор периодически производит осмотр поверхности полосы с использованием системы технического зрения мобильного робота.

Восприятие тепловизионных изображений требует навыков в силу значительных отличий от изображений видимого диапазона. Это обуславливает актуальность предварительной обработки тепловизионных изображений для акцентированной визуализации препятствий. Данная задача может быть решена с помощью методов семантической сегментации. Анализ последних работ в данной области [5-7] показывает, что наиболее перспективным подходом для решения задач семантической сегментации являются глубокие свёрточные нейронные сети.

В данной работе рассматривается разработка новой архитектуры глубокой свёрточной нейронной сети для выделения препятствий на ВПП. На вход сети поступает многоспектральное изображение, включающее каналы в видимом и инфракрасном диапазонах. На выходе сеть выдаёт меточное изображение, на котором визуализируются два класса объектов: фон и препятствие. Разработанная архитектура основывается на архитектуре сети SqueezeNet [8]. В отличие от задачи классификации объекта на изображении, при решении задачи семантической сегментации требуется предсказать тип объекта в каждом пикселе исходного изображения. Для восстановления исходного разрешения изображения к архитектуре сети SqueezeNet были добавлены два слоя деконволюции.

По сравнению с альтернативными методами выделения препятствий на ВПП предлагаемый подход обладает рядом преимуществ. Во-первых, свёрточные нейронные сети позволяют производить обучение без насыщения: при поступлении новых изображений в обучающую выборку качество распознавания препятствий постоянно растёт. Во-вторых, в отличие от систем, основанных на выделении препятствий на основе модели движения камеры [11,12], предлагаемый подход обеспечивает выделение препятствий при произвольной траектории движения.

2. Постановка задачи

Рассматривается задача в следующей постановке: колёсный робот, оснащённый многоспектральной системой технического зрения (СТЗ) FLIR ONE (рис. 1) производит обзор поверхности ВПП. Требуется осуществить обработку изображений, поступающих от СТЗ, для акцентированной визуализации типовых препятствий (выделение контуров, маркирование цветом и т.п.). Нахождение визуальных контуров препятствия производится с помощью глубокой свёрточной нейронной сети. Таким образом, постановка задачи сводится к семантической сегментации многоспектральных изображений на два класса: фон и препятствие.

Рис. 1. Мобильный робот с многоспектральной камерой FLIR ONE.

Целевая функция. Пусть на вход сети поступает

многоспектральное изображение ![]() . Требуется

обучить целевую функцию

. Требуется

обучить целевую функцию ![]() ,

которая производит отображение комплексированного изображения в меточное

изображение

,

которая производит отображение комплексированного изображения в меточное

изображение ![]() , где H,W

- размеры изображения, а метки 0 и 1 обозначают, соответственно, фон и

препятствие. Для достижения равномерной сходимости обучения при обучении

используется многомодальная функция потерь

, где H,W

- размеры изображения, а метки 0 и 1 обозначают, соответственно, фон и

препятствие. Для достижения равномерной сходимости обучения при обучении

используется многомодальная функция потерь ![]() [10],

которая задаётся уравнением

[10],

которая задаётся уравнением

![]() (1)

(1)

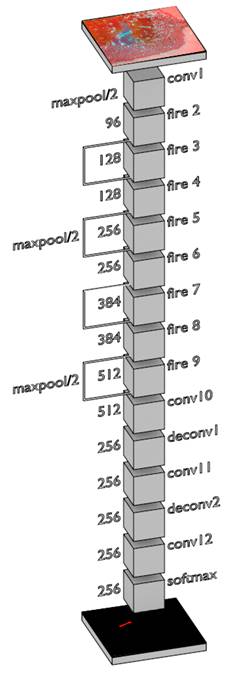

3. Архитеутра сети

Анализ последних работ в области семантической сегментации [3,5-7] показывает, что наиболее высокой точности классификации позволяют достичь алгоритмы на основе глубоких свёрточных нейронных сетей. В отличие от традиционных архитектур сетей, используемых для классификации изображений, в архитектурах сетей для семантической сегментации, как правило, отсутствуют полносвязные слои. Также в данных сетях широко используются слои деконволюции.

Для обучения целевой функции ![]() требовалось

разработать архитектуру глубокой свёрточной нейронной сети для семантической

сегментации. Для достижения вычислительной эффективности за основу архитектуры

была взята сеть SqueezeNet [8]. Основным преимуществом сети SqueezeNet является

выигрыш в производительности в 50 раз по сравнению с сетью AlexNet [4], при

сохранении сопоставимой точности классификации. Для обеспечения вычислительной

эффективности произведено уменьшение размеров фильтров свёртки с 3*3 на 1*1.

Благодаря этому число обучаемых параметров сократилось в 9 раз. Таким образом,

сеть строится из однотипных модулей, называемых «fire module». Для обеспечения

устойчивого выделения препятствий в архитектуру разрабатываемой сети (рис. 2})

был внесён ряд изменений. Во-первых, для восстановления пространственного

разрешения входного изображения были добавлены два слоя деконволюции.

Во-вторых, для уменьшения количества параметров удалён слой субдискретизации

(global avgpool).

требовалось

разработать архитектуру глубокой свёрточной нейронной сети для семантической

сегментации. Для достижения вычислительной эффективности за основу архитектуры

была взята сеть SqueezeNet [8]. Основным преимуществом сети SqueezeNet является

выигрыш в производительности в 50 раз по сравнению с сетью AlexNet [4], при

сохранении сопоставимой точности классификации. Для обеспечения вычислительной

эффективности произведено уменьшение размеров фильтров свёртки с 3*3 на 1*1.

Благодаря этому число обучаемых параметров сократилось в 9 раз. Таким образом,

сеть строится из однотипных модулей, называемых «fire module». Для обеспечения

устойчивого выделения препятствий в архитектуру разрабатываемой сети (рис. 2})

был внесён ряд изменений. Во-первых, для восстановления пространственного

разрешения входного изображения были добавлены два слоя деконволюции.

Во-вторых, для уменьшения количества параметров удалён слой субдискретизации

(global avgpool).

Рис. 2. Архитектура сети.

4. Построение обучающей выборки

Обучающая выборка для семантической сегментации состоит из

пар геометрически выровненных многоспектральных изображений ![]() и

меточных изображений

и

меточных изображений ![]() .

Комплексирование видимого и инфракрасного изображений осуществлялось путём

замены красного канала исходного изображения видимого диапазона на изображение

инфракрасного диапазона.

.

Комплексирование видимого и инфракрасного изображений осуществлялось путём

замены красного канала исходного изображения видимого диапазона на изображение

инфракрасного диапазона.

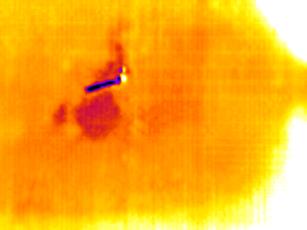

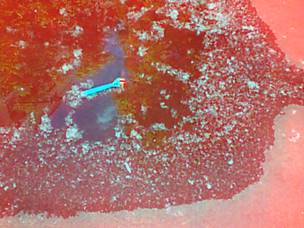

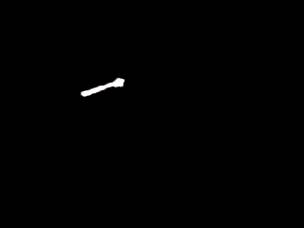

Для построения истинных меточных изображений для обучающей выборки использовался метод оценки траектории камеры, предложенный в[13]. Примеры исходных изображений, а также компенсированного и меточного изображений приведены на рисунке 3. Съёмка исходных изображений осуществлялась с помощью прототипа мобильного колёсного робота для уборки ВПП [1,2].

|

(a) Видимый диапазон |

(b) ИК-диапазон |

|

(с) Многоспектральное изображение X |

(d) Меточное изображение Y |

Рис. 3. Примеры изображений из обучающей выборки. Условное препятствие (разводной ключ) расположено в центре кадра.

Прототип мобильного робота для уборки ВПП. Для подготовки тестовой выборки использовался колёсный робот, оснащённый многоспектральной системой технического зрения. Робот построен на базе колёсной платформы «Hercules» и одноплатного компьютера «Raspberry Pi» (рисунок 1). В качестве многоспектральной системы технического зрения использовалась многоспектральная камера «FLIR ONE», подключённая к смартфону. Разрешение камеры в видимом диапазоне составляет 640х480 пиксел, в инфракрасном - 160х120 пиксел. Параметры камеры FLIR ONE приведены в таблице

Таблица 1. Характеристики камеры FLIR ONE

|

Характеристики FLIR ONE |

|

|

Диапазон температур |

-20°С до 120°С |

|

Вес |

29 грамм |

|

Размеры ( Д х Ш х В) |

72 х 26 х 18 |

|

Чувствительность |

0,1°С |

|

ТВ камера |

640 х 480 пикселей |

|

ИК камера |

160 х 120 |

|

Поле зрения |

46° х 35° |

Управлением роботом осуществляется с персонального компьютера по каналу сети Wi-Fi. Для управления роботом был разработан специальный протокол и приложения клиент/сервер для «Raspberry Pi» и персонального компьютера.

5. Обучение свёрточной нейронной сети и тестирование алгоритма

Обучение разработанной архитектуры сети производилось в среде NVIDIA DIGITS с использованием графического процессор Titan X PASCAL.

Тестирование обученной сети проводилось на тестовой выборке, объёмом в 300 пар изображений. Для определения качества работы сети использовалась бинарнарная мера сходства Intersection over Union (IU), определяемая соотношением:

![]() (2)

(2)

где ![]() --

площадь пересечения области препятствия на построенном меточном изображении и

на эталонном меточном изображении,

--

площадь пересечения области препятствия на построенном меточном изображении и

на эталонном меточном изображении, ![]() --

площадь объединения данных областей. Как правило, значение IU > 50.0%

считается показателем приемлемого качества сегментации [9]. Примеры полученных

меточных изображений представлены на рисунке 4. Значения IU для

различных условий приведены в таблице 2.

--

площадь объединения данных областей. Как правило, значение IU > 50.0%

считается показателем приемлемого качества сегментации [9]. Примеры полученных

меточных изображений представлены на рисунке 4. Значения IU для

различных условий приведены в таблице 2.

Таблица 2. Значение IU для различных условий

|

Условия |

Intersection over Union |

|

Тень |

62.6 |

|

Солнце и тень |

50.1 |

|

Мокрый асфальт |

49.3 |

|

(a) Комплексирование |

(b) Результат работы сети |

Рис. 4. Примеры работы сети.

6. Выводы

В работе предложен метод визуализации препятствий на поверхности ВПП с использованием глубокой свёрточной нейронной сети. Метод предназначен для решения задачи помощи оператору мобильного колёсного робота в обнаружении посторонних препятствий на поверхности ВПП. Он позволяет повысить эффективность обнаружения препятствий в ночное время и в условиях ограниченной видимости.

Для реализации метода разработана архитектура сети для выделения визуальных контуров препятствий. Произведено обучение и тестирование сети. Для обучения сети использовалась обучающая выборка объёмом 4000 пар комплексированных и меточных изображений. Съёмка изображений для обучающей и тестовой выборок производилась с помощью колёсного робота, оснащённого многоспектральной камерой FLIR ONE. Выборка включает снимки условных препятствий (разводной ключ, детали конструкции, предметы багажа и т.п.), полученные в различных условиях: прямой солнечный свет, граница света и тени, мокрый асфальт. Истинные меточные изображения были построены с использованием программы трёхмерного моделирования. Обучение сети производилось в среде NVIDIA DIGITS.

Тестирование разработанной сети производилось на независимой выборке объёмом в 300 пар изображений. Для определения точности выделения препятствий использовалась метрика Intersection over Union. Анализ полученных результатов показал, что сеть успешно производит выделение препятствия во всех рассмотренных условиях. Средняя точность выделения контуров препятствия по метрике Intersection over Union составила~54%

Благодарности

Исследование выполнено при финансовой поддержке РФФИ в рамках научных проектов 16-38-00940 мол_а и 17-29-03185 офи_м.

Ссылки

Kniaz V.V. Fast instantaneous center of rotation estimation algorithm for a skied-steered robot. SPIE Optical Metrology. 2015. Jun. Vol. 9528. P. 95280L–95280L–11.

Kniaz V.V. Real-time optical flow estimation on a GPU for a skied-steered mobile robot. 2016. Apr. P. 989706–989706–12.

Kniaz V.V., Gorbatsevich V.S., Mizginov V.A. Thermalnet: a deep convolutional network for synthetic thermal image generation. ISPRS. International Archives of the Photogrammetry, Remote Sensing and Spatial Information Sciences. 2017. Vol. XLII-2/W4. P. 41–45. URL: http://www.intarch- photogramm-remote-sens-spatial-inf-sci.net/XLII-2- W4/41/2017/.

Krizhevsky A, Sutskever I, Hinton G E. Imagenet classification with deep convolutional neural networks. Advances in Neural Information Processing Systems. 2012

Long J., Shelhamer E., Darrell T. Fully convolutional networks for semantic segmentation. IEEE Conference on Computer Vision and Pattern Recognition (CVPR). 2015.

Long J., Shelhamer E., Darrell T. Fully Convolutional Models for Semantic Segmentation. CVPR 2015, and PAMI 2016. 2016.

Vygolov O.V., Gorbatsevich V.S., Kostromov N.A. et al. Semantic image segmentation for information presentation in enhanced vision. Proc. SPIE. 2017. Vol. 10197. P. 101970H–101970H–8. URL: http://dx.doi.org/10.1117/12.2262507.

Iandola F.N., Moskewicz M.W., Ashraf K. et al. SqueezeNet: AlexNet-level accuracy with 50x fewer parameters and <1MB model size. CoRR. 2016. Vol. abs/1602.07360. URL: http://arxiv.org/abs/1602.07360.

Everingham M., Van Gool L., Williams C. K. I. et al. The Pascal Visual Object Classes (VOC) Challenge. International Journal of Computer Vision. 2009. Vol. 88, no. 2. P. 303–338.

Zhang R., Isola Ph., Efros A.A. Colorful Image Colorization. ECCV. 2016. Vol. 9907, no. Chapter 40. P. 649–666.

Zheltov S, Sibiryakov A. Method of 3d-object detection based on orthophoto difference analysis. International Archives of Photogrammetry and Remote Sensing. Vol. XXXIII, Part B3. Amsterdam 2000. 2000. P. 1041–1047.

Бусурин В. И., Князь В. В. Автоматическое обнаружение препятствий на взлётно-посадочной полосе средствами технического зрения. Труды МАИ, 2014. Т. 81.

Князь В. В., Мизгинов В. А., Горбацевич В. С. Создание модельных изображений инфракрасного диапазона и оценка их визуального качества с использованием свёрточных нейронных сетей. Научная визуализация, 2016. Т. 8. С. 67 79.

FOREIGN OBJECT DETECTION IN TV AND LWIR IMAGERY OF A RUNWAY BY DEEP CONVOLUTIONAL NEURAL NETWORKS

V.V. Kniaz1,2, V.V. Fedorenko1, V.A. Mizginov1, V.A. Knyaz1,2, W. Purgathofer3

1 State Res. Institute of Aviation Systems (GosNIIAS), Moscow, Russian Federation;

2 Moscow Institute of Physics and Technology (MIPT), Russian Federation;

3TU-Wien – Vienna University of Technology, Wien, Austria.

vl.kniaz@gosniias.ru, vfedorenko@gosniias.ru, vl.mizginov@gosniias.ru, knyaz@gosniias.ru, wp@cg.tuwien.ac.at

Abstract

The presence of foreign objects on airport runways poses a significant threat to the safety of air travel. Infrared camera based runway monitoring systems for automatic detection and visualization of foreign objects are highly demanded nowadays. Deep neural networks have recently became a powerful instrument for analysis of multispectral image sequences. This paper is focused on the development of an new deep neural network architecture for automatic detection of foreign objects on a runway. The architecture is based on the SqueezeNet network. The new network performs detection using a pair of images captured in visible and far infrared ranges.

Keywords: deep convolutional neural networks, thermal vision, obstacle detection, runway, semantic segmentation, visualization.

References

1. Kniaz V.V. Fast instantaneous center of rotation estimation algorithm for a skied-steered robot. SPIE Optical Metrology. 2015. Jun. Vol. 9528. P. 95280L–95280L–11.

2. Kniaz V.V. Real-time optical flow estimation on a GPU for a skied-steered mobile robot. 2016. Apr. P. 989706–989706–12.

3. Kniaz V.V., Gorbatsevich V.S., Mizginov V.A. Thermalnet: a deep convolutional network for synthetic thermal image generation. ISPRS. International Archives of the Photogrammetry, Remote Sensing and Spatial Information Sciences. 2017. Vol. XLII-2/W4. P. 41–45. URL: http://www.intarch- photogramm-remote-sens-spatial-inf-sci.net/XLII-2- W4/41/2017/.

4. Krizhevsky A, Sutskever I, Hinton G E. Imagenet classification with deep convolutional neural networks. Advances in Neural Information Processing Systems. 2012

5. Long J., Shelhamer E., Darrell T. Fully convolutional networks for semantic segmentation. IEEE Conference on Computer Vision and Pattern Recognition (CVPR). 2015.

6. Long J., Shelhamer E., Darrell T. Fully Convolutional Models for Semantic Segmentation. CVPR 2015, and PAMI 2016. 2016.

7. Vygolov O.V., Gorbatsevich V.S., Kostromov N.A. et al. Semantic image segmentation for information presentation in enhanced vision. Proc. SPIE. 2017. Vol. 10197. P. 101970H–101970H–8. URL: http://dx.doi.org/10.1117/12.2262507.

8. Iandola F.N., Moskewicz M.W., Ashraf K. et al. SqueezeNet: AlexNet-level accuracy with 50x fewer parameters and <1MB model size. CoRR. 2016. Vol. abs/1602.07360. URL: http://arxiv.org/abs/1602.07360.

9. Everingham M., Van Gool L., Williams C. K. I. et al. The Pascal Visual Object Classes (VOC) Challenge. International Journal of Computer Vision. 2009. Vol. 88, no. 2. P. 303–338.

10. Zhang R., Isola Ph., Efros A.A. Colorful Image Colorization. ECCV. 2016. Vol. 9907, no. Chapter 40. P. 649–666.

11. Zheltov S, Sibiryakov A. Method of 3d-object detection based on orthophoto difference analysis. International Archives of Photogrammetry and Remote Sensing. Vol. XXXIII, Part B3. Amsterdam 2000. 2000. P. 1041–1047.

12. Busurin V. I., Knjaz' V. V. Avtomaticheskoe obnaruzhenie prepjatstvij na vzljotno-posadochnoj polose sredstvami tehnicheskogo zrenija [Automatic detection of obstacles on the runway by means of technical vision]. Proceedings of the MAI, 2014. Vol. 81.

13. Knjaz' V. V., Mizginov V. A., Gorbacevich V. S. Sozdanie model'nyh izobrazhenij infrakrasnogo diapazona i ocenka ih vizual'nogo kachestva s ispol'zovaniem svjortochnyh nejronnyh setej [Generation of synthetic infrared images and their visual quality estimation using deep convolutional neural networks]. Scientific Visualization, 2016. Vol. 8. Pp. 67 79.